Link to original video by Stanford Online

Stanford CS229: Machine Learning - Linear Regression and Gradient Descent | Lecture 2 (Autumn 2018)

Tóm tắt video "Stanford CS229: Machine Learning - Linear Regression and Gradient Descent | Lecture 2 (Autumn 2018)"

Tóm tắt ngắn:

- Video giới thiệu về thuật toán học máy đơn giản là hồi quy tuyến tính và thuật toán gradient descent để tìm tham số tối ưu cho mô hình.

- Các điểm chính được thảo luận bao gồm: cách biểu diễn giả thuyết, hàm chi phí, gradient descent (batch và stochastic), phương trình bình thường.

- Video sử dụng ví dụ về dự đoán giá nhà để minh họa cho các khái niệm.

- Các ứng dụng của hồi quy tuyến tính và gradient descent rất rộng rãi trong nhiều lĩnh vực như dự đoán, phân tích dữ liệu, v.v.

Tóm tắt chi tiết:

1. Giới thiệu về hồi quy tuyến tính:

- Video bắt đầu bằng việc giới thiệu khái niệm học máy có giám sát (supervised learning) và phân biệt giữa bài toán hồi quy (regression) và phân loại (classification).

- Hồi quy tuyến tính là một thuật toán học máy đơn giản, được sử dụng để dự đoán giá trị liên tục dựa trên các biến đầu vào.

- Ví dụ được sử dụng là dự đoán giá nhà dựa trên diện tích và số phòng ngủ.

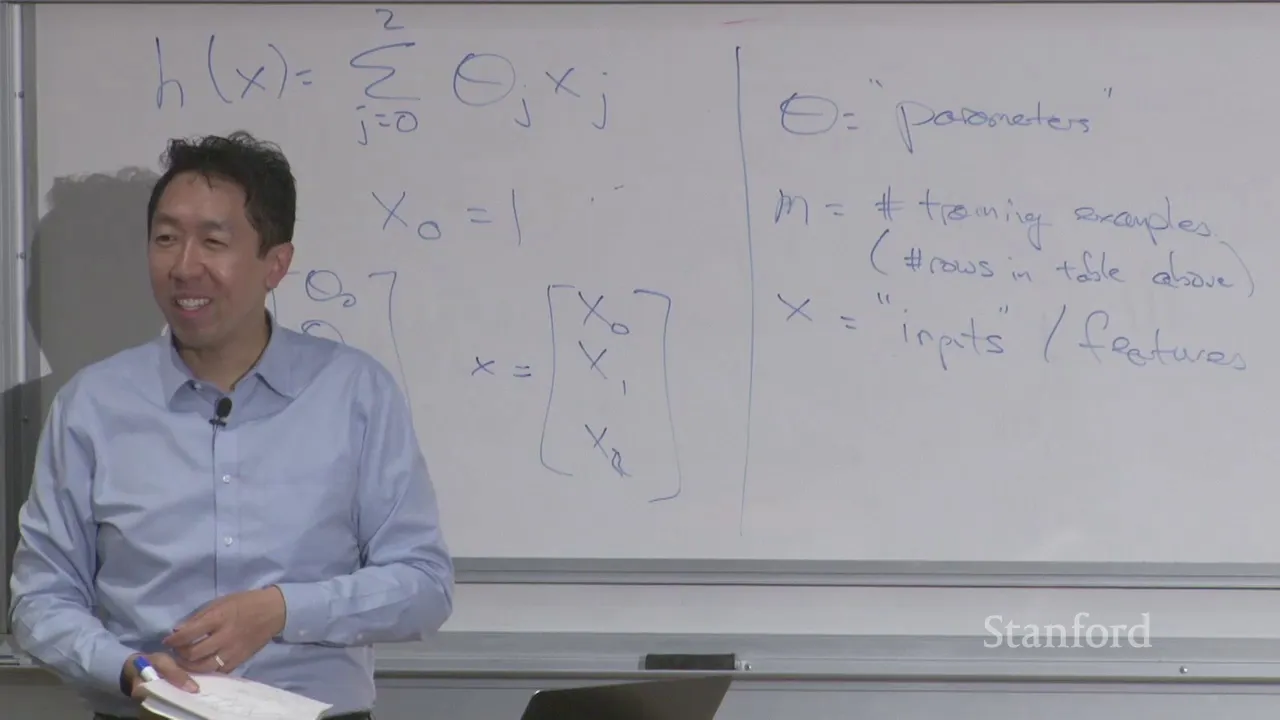

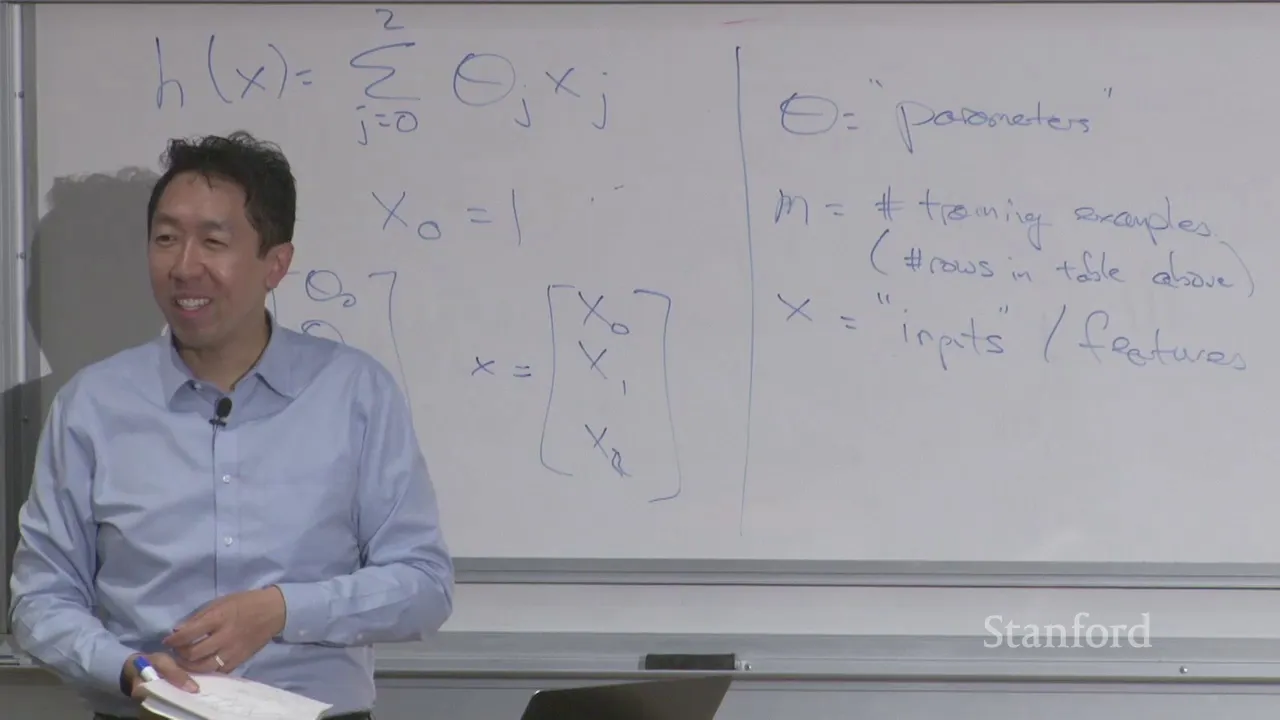

- Giả thuyết (hypothesis) trong hồi quy tuyến tính được biểu diễn bằng một hàm tuyến tính của các biến đầu vào.

- Hàm chi phí (cost function) được định nghĩa là tổng bình phương sai số giữa giá trị dự đoán và giá trị thực tế.

2. Thuật toán gradient descent:

- Gradient descent là một thuật toán tìm tham số tối ưu cho mô hình bằng cách lặp đi lặp lại cập nhật tham số theo hướng giảm hàm chi phí.

- Video minh họa gradient descent bằng hình ảnh 3D, mô tả cách thuật toán di chuyển trên bề mặt hàm chi phí để tìm điểm cực tiểu.

- Hai loại gradient descent được giới thiệu: batch gradient descent và stochastic gradient descent.

- Batch gradient descent tính toán đạo hàm dựa trên toàn bộ tập dữ liệu, trong khi stochastic gradient descent chỉ sử dụng một mẫu dữ liệu ngẫu nhiên.

- Stochastic gradient descent thường được sử dụng cho các tập dữ liệu lớn vì nó nhanh hơn batch gradient descent.

- Video thảo luận về cách chọn learning rate cho gradient descent và cách xác định khi nào thuật toán hội tụ.

3. Phương trình bình thường:

- Phương trình bình thường là một phương pháp giải tích để tìm tham số tối ưu cho hồi quy tuyến tính.

- Nó cho phép tìm tham số tối ưu trong một bước duy nhất, không cần lặp lại như gradient descent.

- Video giới thiệu về đạo hàm ma trận và cách sử dụng nó để suy ra phương trình bình thường.

- Video minh họa cách biểu diễn hàm chi phí và đạo hàm của nó dưới dạng ma trận.

- Phương trình bình thường được sử dụng để giải quyết hệ phương trình tuyến tính và tìm tham số tối ưu.

4. Kết luận:

- Video kết thúc bằng việc tóm tắt các điểm chính và nhấn mạnh tầm quan trọng của hồi quy tuyến tính và gradient descent trong học máy.

- Video khuyến khích người xem đọc thêm tài liệu chi tiết trong lecture notes.

Một số câu trích dẫn đáng chú ý:

- "Hồi quy tuyến tính là một trong những thuật toán học máy đơn giản nhất."

- "Gradient descent là một thuật toán tìm tham số tối ưu cho mô hình bằng cách lặp đi lặp lại cập nhật tham số theo hướng giảm hàm chi phí."

- "Stochastic gradient descent thường được sử dụng cho các tập dữ liệu lớn vì nó nhanh hơn batch gradient descent."

- "Phương trình bình thường là một phương pháp giải tích để tìm tham số tối ưu cho hồi quy tuyến tính."

- "Hồi quy tuyến tính và gradient descent là những công cụ quan trọng trong học máy."